LU11b - RAG Chatbot

RAG (Retrieval-Augmented Generation) ist eine gängige Variante, um Fragen zu benutzerspezifischen Dokumenten zu beantworten.

© https://www.ridgerun.ai/post/how-to-evaluate-retrieval-augmented-generation-rag-systems

© https://www.ridgerun.ai/post/how-to-evaluate-retrieval-augmented-generation-rag-systems

Zu Beginn muss man die gewünschten Daten (z.B. Lernunterlagen) …

- … in Chunks unterteilen

- … „embedden“

- … in die Vektordatenbank speichern

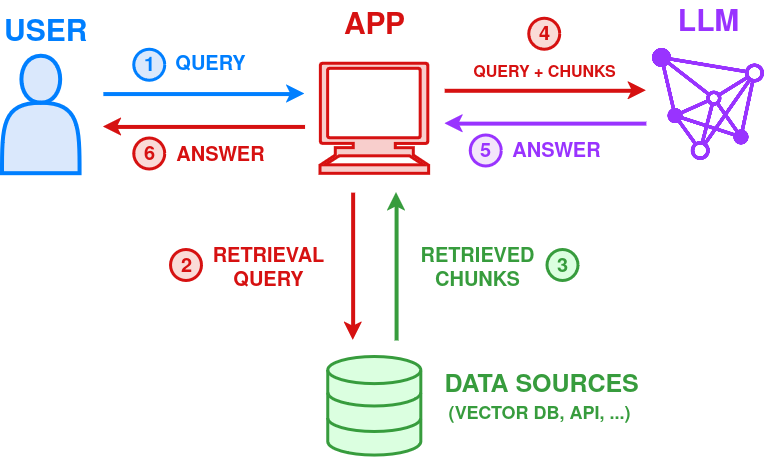

Der Ablauf funktioniert grob so:

- Der Benutzer gibt eine Frage ein, welche an die Applikation geschickt wird.

- Die Frage wird „Embedded“ und an die Vektordatenbank geschickt

- Von der Vektordatenbank werden die n passendsten Chunks im Klartext an die Applikation zurückgegeben.

- Die Applikation schickt die originale Frage im Klartext mitsamt den Chunks an ein LLM-Model

- Das LLM-Model schickt eine Antwort zurück an die Applikation

- Die Applikation kann z.B. Quellen o. Ä. bei Bedarf ergänzen und die Antwort an den Benutzer zurückschicken.